【獵雲網(微信號:ilieyun)】3月4日報導(編譯:金怡琳)

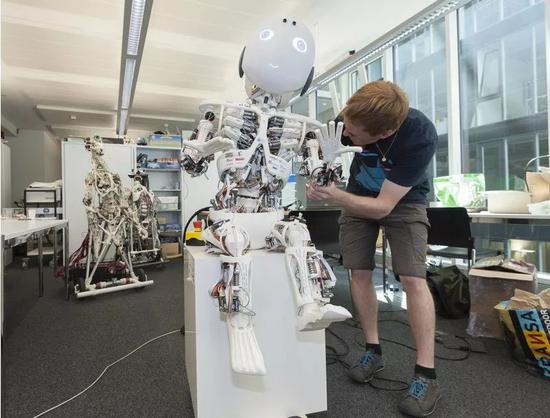

構建合乎道德的人工智能是一項極其複雜的任務。而當利益相關者意識到人工智能要與道德規範相符是局外人的觀點時,事情就變得更加困難了。

加利福尼亞州月半彎——當地一篇新聞報導稱,Clarifa正與美國國防部合作,但有一些員工質疑其開發分析無人機拍攝視頻的人工智能系統的道德性,對此,該公司表示,該項目將能挽救平民和士兵的生命。

“Clarifai的使命是通過不斷改進人工智能技術來加速人類的進步,”該公司創始人兼首席執行官、著名人工智能研究員Matt Zeiler在部落格中寫道。後來,在一次新聞媒體採訪中,Zeiler宣布增加了一個新的管理崗位,這將確保公司的所有項目都符合道德規範。

隨著活動人士、研究人員和記者對人工智能的崛起表示擔憂,並對帶有偏見、欺騙性和惡意的應用發出警告,開發此類人工智能技術的公司正在做出回應。從像谷歌和微軟這樣的科技巨頭,到鬥志昂揚的人工智能初創企業,都在制定企業原則,旨在確保他們的系統以一種合乎道德的方式設計和部署。還有一些公司設立了道德官員或審查委員會來監督這些原則的實施。

但隨著一些人在質疑這些承諾最終能否兌現,緊張的局勢變得愈加嚴峻。企業可以改變方式。而理想主義也可能屈服於財政壓力。一些活動人士——甚至是一些企業——開始辯稱,確保道德規範實踐的唯一途徑是通過政府監管。

但許多政策專家表示,他們認為政府制定的原則不太可能比大公司制定的更具影響力,特別是因為美國國防部在開發類似技術時,有足夠動力與中國、俄羅斯和其他國際競爭對手保持同步。因此,一些人呼籲簽訂禁止使用自主武器的國際條約。

監管是否是最好的方法?

Clarifai的員工在他們的公開信中表示,他們不確定監管是否是解決人工智能技術道德問題的最好方法,並且,他們認為,直接責任在於公司本身。

“監管會減慢研究的步伐,而我們這個物種需要不斷進步,才能在今天面臨的許多威脅中生存下來,”他們在寫給Zeiler和公司其他成員的信中寫道,“我們需要有足夠的道德感,讓人們信任我們,才能靠我們自己來實現這項技術,因此我們有責任讓公眾清楚地了解我們的道德規範原則。”

但他們的信並沒有達到預期的效果。Zeiler解釋說,因為Clarifai很可能會致力於自主武器的開發。幾天后,這封信的作者,也就是之前被任命為道德顧問的Liz O'Sullivan,離開了公司。

像Whittaker這樣的研究人員和活動人士認為,這是一個科技公司的員工可以利用其自身的力量推動變革的時刻。但他們也表示,這必須發生在公司內外都能意識到道德規範重要性的情況下。

Whittaker 表示,“我們確實需要監管。”就連微軟的首席法律官Brad Smith也持有相同觀點。