反智主義盛行,美國可能輸掉全球人工智能競賽

來源:財富中文網

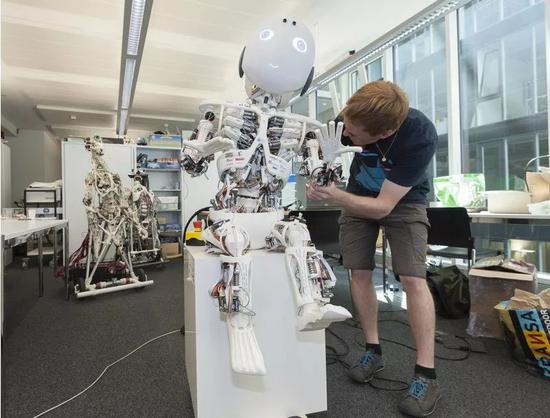

一名科學家在蘇黎士大學的人工智能實驗室裡調試一台名叫ROBOY的人型機器人。EThamPhoto—Getty Images

如果美國真的想領跑全球人工智能競賽,那麽政策制定者最應該避免的,就是用一套低效的監管制度扼殺人工智能的發展潛力。

一個國家徜若在人工智能領域裡贏得了全球的主導權,則必將獲得巨大的經濟利益,其經濟增長率在2035年前甚至可能提高一倍。可惜美國在如何開展競爭上卻沒有得到很好的建議。

過去一年裡,中、日、英、法、印、加等國都啟動了由政府支持的大規模人工智能項目,以在該領域裡拔得頭籌。雖然川普政府也開始關注人工智能技術的發展,但在國家層面上,美國國內並未形成一個有凝聚力的戰略與中日等國抗衡。美國政界反而興起了一股反智主義,決策者們更多擔心人工智能的潛在危害,呼籲給這項技術念“緊箍咒”的多,支持其發展的少。

人工智能確實給社會帶來了一些獨特的挑戰——比如它有可能加劇刑事司法系統中的種族偏見,而自動駕駛汽車技術也產生了一些倫理問題。至於如何解決這些挑戰,也有人給出了一些解決方案,目前最流行的觀點,是要確立人工智能算法的透明性原則或可解釋性原則,或者建立一個最高層級的人工智能監管機構。然而這些措施不僅可能無助於解決問題,反而會嚴重拖慢美國人工智能技術的發展和應用速度。

透明性原則的支持者們認為,應該要求人工智能公司公開源代碼,讓監管機構、記者和有責任心的公民可以對這些代碼進行審查,從而發現任何不法行為的跡象。不過以人工智能系統的複雜性,我們很難相信這種方法會有什麽效果,反而會使那些奉行“拿來主義”的國家的企業更容易偷到美國的原代碼。這種做法顯然會阻礙美國在全球人工智能競賽中的競爭,使美國企業更不願意投資這項技術。

可解釋性原則的支持者則認為,政府應要求公司采取必要措施,使終端用戶有能力解讀他們的算法——比如描述算法的工作原理,或者只允許使用那些能夠解釋清楚其決策機制的算法。比如歐盟就把算法可解釋性作為評估人工智能潛在風險的一個主要指標。歐盟的《通用數據保護條例》(GDPR)規定,一個自然人有權獲得關於算法決策機制的“有意義的資訊”。

可解釋性原則可能是個合理的要求,而且它已經成為了刑事司法或消費金融等很多領域的標準。但是在某些領域裡,你甚至無法要求一個自然人去解釋他的決策機制,你又怎能將這個要求硬套在人工智能身上呢?非要這樣的話,企業只得繼續依賴真人進行決策,以避免監管壓力,而這則會不可避免地造成效率和創新的遲滯。

另外,可解釋性與準確性是魚與熊掌的關係。一個算法越複雜,其準確性一般越高;但一個算法越複雜,它就越難以解釋清楚。這種矛盾是始終存在的。兩個變量的線性回歸,肯定要比200個變量的線性回歸容易解釋。算法使用的數學模型越先進,這種矛盾就愈發尖銳。

因此,可解釋性原則只有在可以犧牲準確性的條件下才能實現,而這種條件顯然太少了。比如對於自動駕駛汽車技術,為了可解釋性而犧牲準確性,後果無疑是災難性的。導航精度哪怕稍稍損失一點,或者電腦某一次不小心將行人和廣告牌上的人像搞混了,都會造成巨大的危險。

另一個頗為流行的餿主意,是建立一個全國性的類似於美國食品與藥品管理局(FDA)和美國國家運輸交通安全委員會(NTSB)的人工智能監管機構。埃隆·馬斯克就堅決支持這一倡議。持這種觀點的人好像把搞人工智能當成了賣衣服和快餐,似乎認為所有人工智能算法都對社會有同樣的危險性。

然而人工智能系統的決策機制也跟人類一樣,是受一系列行業法律法規約束的,其危險性有高有低,主要取決於它的應用場景。你不能只因為它是一個人工智能算法,就對一個低風險的人工智能產品搞監管,這必然會顯著阻礙這項技術的研發,進而限制美國企業採用人工智能技術的能力。

好在政策制定者們還是有一種可行的辦法,既能解決人工智能的潛在威脅,又不會阻礙它的發展——那就是算法責任原則。它是一種低干涉的監管模式,企業只需通過一系列控制機制,驗證他們的人工智能系統是不是按照設計意圖運行,能不能識別和糾正有害結果。它既不會像透明性原則那樣危害知識產權,也不會像可解釋性原則那樣阻礙技術發展,企業仍然可以部署先進的創新人工智能系統。

但在某些特殊情況下,根據實際需要,也可以要求企業解釋其決策機制,不管人工智能系統在這些決策中有沒有被使用。另外根據算法責任原則,各個行業的監管機構也將能夠理解各自領域內的人工智能技術,而不需要建立一個全國性的最高監管機構。這樣也就大大降低了人工智能部署的壁壘。

如果美國真的想領跑全球人工智能競賽,那麽政策制定者最應該避免的,就是用一套低效的監管制度扼殺人工智能的發展潛力。如果政策制定者擔心人工智能的安全問題或是公平問題,他們完全可以採用算法責任原則來化解他們的擔憂,而不是當美國剛站在人工智能競賽的起跑線上,就去一棍子打斷他的腿。

作者:Joshua New(智庫機構數據創新中心高級政策研究分析師,該機構主要研究數據、科技與公共政策的交集)

責任編輯:陳合群