評論贈書:一輛自動駕駛汽車在刹車失靈或者來不及刹車的情況下,正好道路前方有五人闖紅燈,而車上有兩名乘客。此時,自動駕駛汽車如何選擇才是正確的?為什麽?我們將會選3位留言質量量較高的用戶,免費贈送《人工智能:國家人工戰略行動抓手》。(互動平台:“第一財經資訊”微信公眾號)

電車難題是一個非常著名的倫理難題,它設置了一個這樣的場景:

你駕駛著一輛電車行駛在軌道上。在它的前方,有五個人被綁在軌道上不能逃脫。如果電車繼續行駛,就會碾壓到他們。你可以拉一個拉杆,轉到另一條軌道上,但在這條軌道上也綁了一個人。你有兩個選擇:

1. 不拉杆,五人死於你手。

2. 拉杆,一人死於你手。

你會怎麽做?

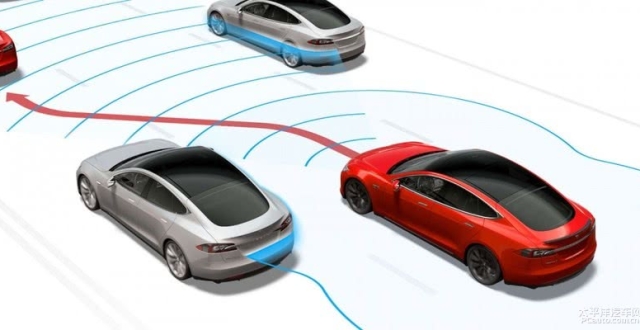

自動駕駛汽車已經上路接受檢測,將來也會碰到類似的難題,它也必須做出相應選擇。

比如,一輛自動駕駛汽車在刹車失靈或者來不及刹車的情況下,正好道路前方有五人闖紅燈,而車上有兩名乘客。此時,自動駕駛汽車有兩個選擇:

1. 繼續前行,撞死不遵守交通規則闖紅燈的五人。

2. 為避開五人轉而撞向路障,車上兩名乘客喪生。

在這種情形下,人們應該期待自動駕駛汽車如何選擇呢?

功利主義認為,從數量上看,五多於二。因此,五個人的生命比兩個人的生命更加重要。這種情況下,應當犧牲少數人的生命從而挽救多數人的性命。但是,生命是無價的,五條命就一定比兩條命更重要嗎?

道德主義認為:人是目的,而並不是工具。因此,不能簡單認為五個人的生命比兩個人的生命更重要。在面對此類兩難選擇時,應當不作為。

有科學家對這類困境做過測試,結果顯示:當乘客和行人數量比例是1:1時,即一名乘客和一名行人時,75%的受訪者表示應該挽救乘客。但是當行人的數量增加時,受訪者開始轉變思想。如果有5名行人和1名乘客,還有50%的受試者表示應該救乘客。但當行人人數達到100人,而乘客是1人時,支持救乘客的受訪者的比例下降到20%左右。但是,如果你就是那一名乘客呢?你希望自動駕駛汽車保護你還是保護行人?

自動駕駛汽車生產廠家該如何設置,才能讓汽車做出公認為正當的選擇?

騰訊在《人工智能:國家人工戰略行動抓手》一書中提出了路徑來嘗試解決這一難題:

事前,為機器設定倫理標準,讓智能機器的自主決策行為尊重人類社會的各種規範和價值。在事中或者事後:政府、公眾共同參與,對人工智能的行為進行監督、審查和反饋,共同實現人工智能倫理,確保公平正義。

接下來的一個問題是:自動駕駛汽車已經按照人類希望的倫理規範行駛了,但仍出錯了怎麽辦?

讓我們看一個案例:2016年5月7日,在美國佛羅裡達州,一輛特斯拉Model S在自動駕駛模式下發生車禍致死事件,引發了全球對自動駕駛系統的質疑。

事故當時的情形是這樣的:事故死者Joshua Brown駕駛Model S與一輛正在轉向的白色拖掛車相撞,導致車頂被削,駕駛員身亡。發生撞擊時,車輛的Autopilot自動駕駛系統正處於開啟狀態。數據表明,當時Model S的時速為119公里/時,而路段限速為105公里/時,車輛處於超速駕駛狀態。

特斯拉內部調查結果顯示,Autopilot自動駕駛系統無法識別白色的拖掛車車體,將其錯誤識別為高架橋,導致自動刹車系統沒有發生作用,車輛直接在拖掛車下方鑽過,並造成車輛失控。

特斯拉曾警告駕駛者雙手不能離開方向盤,並將注意力保持在駕駛上。很多駕駛者都以為特斯拉Autopilot是全自動駕駛系統,這是一個致命錯誤。經過了6個月的調查分析,美國相關部門宣布,沒有證據表明Autopilot自動駕駛系統對事故負有責任,特斯拉無需召回。

那麽,問題來了:自動駕駛汽車發生交通事故後,應當由誰來承擔相應的法律責任呢?

德國的自動駕駛汽車法案做了這樣的規定:司機參與駕駛的,依其注意義務和過錯承擔責任,否則製造商承擔責任。

聯合國教科文組織與世界科學知識與技術倫理委員會提出了一個可行的解決辦法:采取責任分擔的解決途徑,讓所有參與到機器人的發明、授權和分配過程中的人來分擔責任。

評論贈書:一輛自動駕駛汽車在刹車失靈或者來不及刹車的情況下,正好道路前方有五人闖紅燈,而車上有兩名乘客。此時,自動駕駛汽車如何選擇才是正確的?為什麽?我們將會選3位留言質量量較高的用戶,免費贈送《人工智能:國家人工戰略行動抓手》。(互動平台:“第一財經資訊”微信公眾號)