近日,網友 coolwulf 在 V2EX 論壇上分享了自己搭建的深度學習模型,向公眾提供了一個完全免費的網站和客戶端,用以進行乳腺癌的診斷。

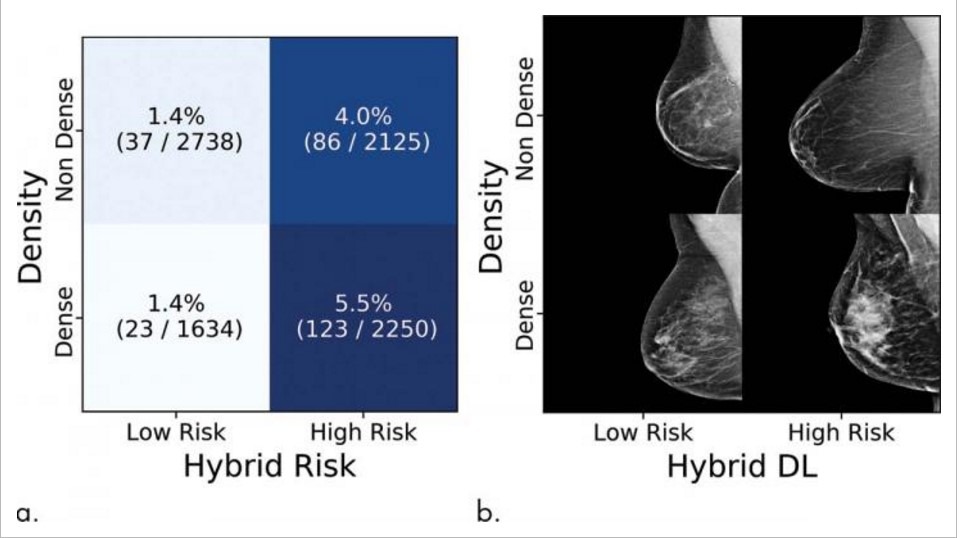

人們可以自己上傳自己的乳腺癌 X 光片,然後迅速得到診斷結果,目前這個模型的診斷準確率已經到達 90%。

coolwulf 為了搭建這個深度學習模型,先在本地使用 50 個 Nvidia Geforce GTX 1080 Ti 的顯卡作為運算的硬體,接著從歐洲和北美的研究組中獲取了乳腺癌影像學的相關數據,用以設計和訓練模型。

▲這個模型的硬體組成,圖片來自:coolwulf

這個模型在 INBreast 資料庫上測試後,準確度達到了 90%。coolwulf 認為這個模型已經可以開放應用,並公布了網址:http://neuralrad.com。

▲ 圖片來自:coolwulf

公眾只需要在網站上傳 JPG 格式的乳腺檢查 X 光片,這個 AI 就會直接給出相應的診斷結果。

同時 coolwulf 也公布了一個桌面版本,能夠讀取和瀏覽 DICOM 格式的醫學影像。

▲ 圖片來自:coolwulf

coolwulf 還在帖子中寫出了搭建這個模型的初衷。去年,他有一個年僅 34 歲的校友,由於乳腺癌沒有獲得及時的診斷和治療去世,留下一個年僅四歲的孩子。在惋惜之餘,他決定動手去做些事情,提高乳腺癌的早期檢測成功率。

擼起袖子就動手去改變世界,而且還能快速落地應用。簡直不要太酷。

在 V2EX 這個帖子的評論區下面,有超過 200 個網友表示佩服和讚許。比如:

mringg:支持!我感覺這才是技術的意義。WytheHuang:上個星期六,母親乳房有腫塊,檢測出四類。對這些不是很懂,不停找資料查看,越看越害怕。尤其是 B 超圖片完全看不懂…… 樓主這個是在太贊了,希望能夠幫助更多人。

丁香園的首席架構師少楠在評論區表示,他們可以提供脫敏數據,用以訓練這個模型。

▲ 一個名為 Deep Fundus 的團隊在帖子中留下他們做的預測模型

在評論區,還有提供眼底影像 AI 診斷的團隊放出了自己的產品。

對於 coolwulf 的這個模型,愛範兒(微信:ifanr)詢問了一位在廣州某三甲醫院工作的醫生朋友 Sukki,她認為人工智慧讀醫療 X 光片這件事情,還有待進一步的發展:

我之前也圍觀過 AI 跟醫生比賽讀 B 超圖片,結果 AI 準確率是挺高的,但是還是不如有經驗的醫生,我覺得可以做為借鑒和參考,但是起碼在可見的未來,我更相信醫生。

coolwulf 也有提到,這個模型也正在與國內一些醫院聯繫,嘗試合作。但在臨床醫生的眼裡,毫無醫學知識的人使用這個網站時,依然需要相信醫生的診斷,Sukki 說:

普通人使用這個網站,就類似於在百度上求醫,我們經常遇到病人跟我們說百度說什麼什麼,畢竟同一個表現,病史不同,診斷可能完全不同,我們影像是需要結合病史來考慮診斷的,所以單憑一個讀片的網站就出結論,很容易造成醫患之間相互不信任的。

我們必須承認,像 coolwulf 這樣的技術和應用,會讓資源不足的人們擁有了更多,也會成為協助醫生診斷的工具。但毫無醫學知識基礎的朋友,還是需要相信醫生。

▲人工智慧界泰鬥之一邁克爾 · 喬丹

加州伯克利大學教授、被稱為 「人工智慧之父」 的邁克爾 · 喬丹,曾在今年的文章《人工智慧:革命尚未到來》中,分享了他女兒出生前的一個故事。

他的妻子在 14 年前懷孕做產檢的時候,基因專家指著 B 超結果告訴他們,檢查結果上的一些白點,顯示他們女兒患上唐氏綜合征的可能性為 1/20。

他對這個「白點」與唐氏綜合征患病率之間的關係產生了懷疑。後來他經過研究發現,當時英國醫學界使用 B 超中的白點作為預測唐氏綜合征的指標。而當時他妻子產檢那家醫院所使用的 B 超機器,成像品質已經有了更多的長進,B 超上多出來的白點,其實只是白噪音。

基金專家知道結果後,她的反應是:「怪不得在前幾年新機器投入使用以後,我們開始發現越來越多的唐氏綜合症患兒。」

總而言之,人工智慧的技術依然在快速發展,其在醫學上的應用就會為醫生的診斷提供強有力的工具,在目前看來,使用這些工具最好的方式,依然是人機協同。