日本《東洋經濟》周刊3月2日發布的題為《美國開始在AI軍事利用上動真格》的文章,現將原文編譯如下:

美國總統川普2月11日簽署總統令,命令聯邦政府加強人工智能技術(AI)開發。次日,五角大樓發布首份《人工智能戰略概要》報告,提出了加速在軍事領域引入AI的方針。

川普發布的總統令主要是以民間產業領域為對象,但他署名時發表聲明稱:“美國在AI領域保持領先地位,對於經濟和國家安全非常重要。”也就是說,川普也尋求AI在軍事層面的優勢地位。

《人工智能戰略概要》則更加直接,點名批評俄羅斯等國在AI軍事利用方面投入巨額資金,搶奪了美國的技術優勢,動搖了國際秩序。報告提出,要擴充2018年在國防部內部新設的“AI中心”,加強與民間企業、學術機構以及盟國的合作。

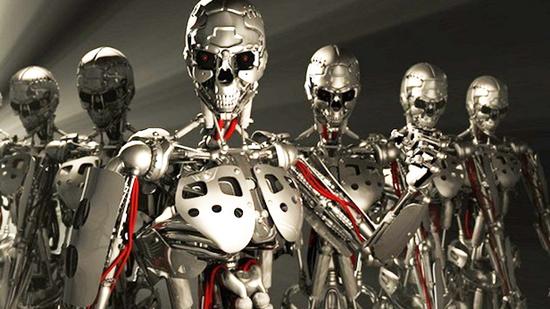

進入21世紀後,全世界的軍事專家和研究人員一直在爭論一個被稱為“終結者”的嚴重問題。原因是,由於深度學習所反映出的AI的飛躍式進步,可識別敵我並能判斷是否發動攻擊的殺手機器人武器登場亮相,使“終結者”問題具有現實性。

根據人類多大程度參與從識別到攻擊的決定,殺手機器人可以分為3類。一類是完全由人類決定、由人遠程操作的無人機。具體來說,美國MQ-1“捕食者”偵察機就是典型代表。第二類是機器人可以自己判斷,但中途人類可以中斷或取消的半自主型。以色列的“哈比”自殺式無人機就是這種類型。這兩類都已經實戰部署。被視為“終結者”問題的是第三類,它是人類完全不參與決策過程的自主型殺手機器人。

關於自主型殺手機器人,其風險包括:程序錯誤等原因導致誤傷、擴散至恐怖分子手中、自主判斷做出人類意想不到的敵對行為、決定攻擊作戰時抑製力下降等。

推進派的專家們則主張,自主型殺手機器人“可以減少被憤怒和恐怖驅使的不必要的殺傷”“可以降低己方軍隊士兵的被殺傷率”“可以維持本國的軍事優勢”“成功量產能削減軍費”等。

然而,我們真的能夠允許將殺傷人類的判斷交給不能承擔責任的AI嗎?

關於自主型殺手機器人,日本外相河野太郎在去年11月眾議院外務委員會上明確表示,“日本采取應該禁止的立場”“沒有開發的意向”。然而,在聯合國專家會議等場合上,日本的主張極其微弱。

美國國防部的立場是“讓人類參與判斷”。美國為了維持本國在這個領域的優勢,不同意采取限制措施。有專家甚至預測,在不久的將來,全世界都會擁有自主型殺手機器人。

對於所有國家的領導人來說,不論大國、小國,自主型殺手機器人的“優點”是極具誘惑力的。對奉行“本國優先”、重視計算得失的川普來說,尤其如此。

如果再加上對其他國家先行擁有的恐懼,關於倫理是否正確的問題很可能不再是考慮對象。這些情況都在支持“不久全世界都擁有”的預測。

有觀點認為,AI不會出現在前線,而是越來越多地被用在司令部啟動、策劃和執行作戰的過程中。因此,不同於人類與機器人關係的3種分類方式,AI軍事化的新類型可能率先成為現實——不進行個別的殺傷判斷,以己方士兵損害最小化和敵方損害最大化為目的、針對整個戰鬥做出判斷的“AI參謀”。

要想阻止和推翻噩夢般的預測,需要國際性的輿論合力,但各國軍方仍在暗處激烈地進行開發競爭。

與瞬間造成大規模破壞和大量軍民死亡的核武器那種大規模殺戮武器不同,不身處戰場的普通人可能無法實際感受到殺手機器人的反人道性。

然而,在這個問題上,美國領導人很難自己踩刹車,幾乎已經不可能回頭。從川普簽署的總統令可以讀出這樣的信息:為對抗中俄,世界上最大的軍事強國必須正面參與開發競爭。