圖片來源:視覺中國

文|智能相對論(aixdlun),作者|胡蝶

很多人都想擁有一個能陪伴自己的暖心“大白”,但能像大白一樣讀懂人類情緒的機器人真的存在嗎?

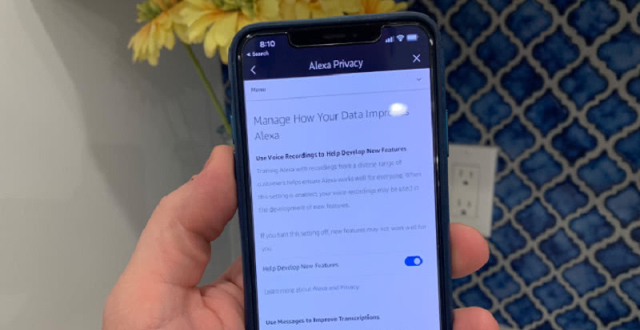

近日亞馬遜稱其語音助手Alexa能夠通過分析用戶指令的高低和音量等反應,識別出“快樂、高興、憤怒、悲傷、煩躁、恐懼、厭惡、厭倦、壓力”等情緒,並對相應指令做出回應。

其實,並不只有這一個項目在探究人類情緒。

比如上面提到的亞馬遜,他們早在一年前就已經宣布展開對聲音中包含的情緒狀態進行分析的研究。

谷歌等公司也沒有停止在這一領域的追逐賽。谷歌在開發檢測負面情緒的設備;IBM通過面部識別攝影頭和掃描用戶心率和腦電波來結合搜索引擎給出結果;而Realeyes公司則通過網絡攝影頭或智能手機識別面部情緒。

讀懂情緒,是隱私的小偷還是專屬的管家?

目前多家科技公司在人工智能識別情緒方面投入了巨大努力,像亞馬遜在目前階段就給出了Alexa語音助手這一答卷。

相信很快就會有識別情緒更準確的產品面世,情感人工智能和情緒識別技術也正在日趨成熟並將逐漸應用於各個領域,這意味著,我們正在走進一個情緒被監控、評估和記錄的時代。那麽這對我們的生活來說到底是好是壞呢?

大數據時代,也是一個個人隱私被輕易竊取的時代。一位專家曾表示:“現在的互聯網用戶大致可以分為兩種,一種是被黑過的,另一種是不知道自己已經被黑過的。”

打著“私人訂製”和“個性化服務”的旗號,而實際上更多的是用戶隱私資訊在被濫用和超額壓榨價值。我們被服務者搜集的個人隱私,一旦遭受黑客攻擊,就會面臨被泄露甚至被濫用的尷尬境地。

黑客對CloudPets製造商Spiral Toys的聯網毛絨玩具的攻擊,使大批用戶的密碼、郵件地址以及家長與孩子之間的220萬個私人語音資訊被披露在網上。

這樣的例子屢見不鮮,公眾對於自己個人隱私資訊被泄露的擔憂程度下降並不意味著自己的隱私得到了更好的保護,恰恰相反,這只能代表被盜取和泄露的手段更加高超罷了。

很多人以為個人情緒就像自己腦海裡的想法一樣,是被盜取不了的。但其實盜取想法並非不可能,通過腦機接口技術(BCI)就能做到,像CBD街上有很多的VR體驗店,經常有人覺得很新鮮進去體驗一下。

對於VR頭顯製造商而言,並不用費很大力氣就能利用頭顯設備秘密收集用戶的生理反應數據,竊取到用戶最隱秘的想法。同樣,情緒識別人工智能的發展,就像一個“情緒黑客”,也像一個“隱私小偷”,包含情緒在內的人類的隱私,將面臨最全面最嚴峻被竊取風險。

但不可否認的是,任何事物都有它的兩面性。我們在埋怨頭條新聞竊取個人隱私資訊的同時,我們也的確享受著它的個性化推送。這種能夠讀懂主人情緒並作出反應的智能機器人,頗像一個貼心的專屬管家。

假設主人回到家中發出指令準備30分鐘以後去浴室泡澡,那麽這個專屬管家通過分析主人的狀態是疲倦還是高興,在浴室調試好相應的水溫、音樂甚至光線。在主人夜間做噩夢的時候根據夢話檢測到其情緒變化並及時釋放安息凝神的熏香……

不過,這是一塊難啃的骨頭

智能相對論了解到,識別分析情緒可以分為三種途徑:

一類是像亞馬遜這類,從分析聲音入手(這裡我將其簡稱為語音派);

一類是以IBM和Spotify為代表的通過分析用戶的搜索結果和下載內容(內容派);

還有一類是以倫敦Realeyes公司為代表的通過建立數據庫和拍攝技術識別面部表情(拍攝派)。

人的情緒,最直接的就是通過行為表現出來,行為又包括表情、語氣、動作等內容。先不說內容派的分析過於間接,可信度較低,就連直接分析語音和表情的語音派和拍攝派,智能相對論都覺得太過於片面。

人的情緒之所以難懂,就是因為它的表現具有選擇性。雖然在行為學中,微表情能夠一定程度上讀出人內心的真實想法,但是在一個人不管是出於禮儀規範還是某些特殊需要的約束而刻意隱瞞自己的情緒的狀態下,單純分析語音或者表情的人工智能能夠做得到準確識別人類複雜的心理活動嗎?更何況人類的情緒也不是一成不變的,都說“女人心思百折千回”,人的內心活動可能瞬息萬變,這也增加了人工智能正確識別人類情緒的難度。

正如亞馬遜公司的Prasad在記者會中說的:“(這項技術)目前還處於早期研究階段,在遠場音頻中檢測沮喪和情緒是很困難的,另外AI還需要明確人類是否感到沮喪的基礎標準。”面部分析的原理尚且薄弱,聲音分析就更別說了,與複雜的情緒相比,聲音傳遞的資訊確實算少。更何況在當今複雜的社會環境中,這兩項技術是否能夠通得過變聲器和整容等挑戰還未可知。

智能相對論認為,如果還是單純從一方面入手想要啃下這塊難啃的骨頭,恐怕結果不太樂觀。

AI情緒分析到底面臨著哪些“攔路虎”?

接下來我們就來說說為什麽不樂觀。這不禁要問人類是如何識別他人的情緒的?我們知道動物可以通過辨別對方散發的氣味來判斷情緒,但人類的情緒判斷過程遠遠不止這麽簡單。參考人類的識別過程,AI至少面臨著這幾個問題:

1、單維度不準確,多維度不擅長。

判斷情緒的算法應該從幾個維度出發?面部表情、聲音的波動頻率、搜索內容……如果要達到相當高的準確率,那麽從單維度出發肯定是做不到的。如果維度過高比如連溫度和呼吸頻率都加上的話,那麽不僅對算法來說是一個巨大的挑戰,而且也是資源的無謂浪費。選擇幾個維度和選擇哪幾個維度是關鍵,比如從腦電波、人體激素分泌或者人體磁場這些方面入手。

2、定義情緒和識別情緒不是一回事。

如Prasad所說,我們要能夠給出各種情緒的定義。但我們並不一定能給出沮喪的定義,卻能判斷一個人是否沮喪。這是因為我們從出生起就浸淫於社會行為的大環境中。如果把我們比作AI,那就是我們擁有足夠龐大的數據庫。所以,即使有一個相對完善的算法模型,也需要有異常龐大的數據庫來訓練這個模型。如此規模的數據收集,就算在今天科技成果的加持下,也並不是一件容易且短時間能完成的事情。

3、AI在識別情緒這條路上,如何突破“情緒壁壘”?

我們人類不是《三體》中的“三體人”,我們會根據需要隱藏情緒。AI如果不能實現對“情緒壁壘”的突破,就無法真正完成它的征途。人行為的複雜程度連最厲害的級電腦都無法解讀,所有涉及到情感的嘗試,都是AI研究中的最大難點。

情緒分析技術,未來可以去哪裡發光發熱?

最後,我們講講技術落地的可能。我們分析用戶的情緒狀態,聽起來非常神奇,而目前的應用卻局限在銷售產品和個性化行銷上。

亞馬遜開發這款智能語音助手也只是為了提供針對性的音頻廣告和促銷。Spotify也是根據播放列表與情緒的關聯向廣告公司出售廣告位。從各大公司的不懈努力可以看出,即使成果尚微,這項技術也還是有著巨大的潛力和背景。但智能相對論認為,這項技術的應用大舞台恐怕不是在行銷上。

比如,MIT Media Lab希望將情感識別技術應用於檢測司機駕駛過程中的疲勞狀態、研究觀眾如何與電視節目互動、根據情緒狀態來診斷像抑鬱病這種普通醫療手段難以發現的心理疾病……

比如,人的情緒識別之前可以先嘗試動物情緒識別。動物的情緒並沒有人這麽複雜,如果有一套設備能夠幫助主人感知寵物情緒,那麽動物和人的相處會更加和諧。現在大熊貓等這類珍稀保護動物不是培育不易、繁衍更不易嗎?如果飼養員能夠更好的了解動物情緒,就能夠更好的幫助這些珍惜動物生存和繁衍。

再比如,這項技術在監護嬰兒的成長狀態上或許大有作為。對於懵懂而不懂得表達的嬰兒來說,他們最直接的情緒宣泄方式就是通過聲音和動作。兒童的情緒相對而言比較容易識別也更少矯飾。

當然,帝國理工學院教授馬佳·潘迪克表示希望該技術有朝一日能夠幫助自閉症兒童或者抑鬱症患者。的確,不管是自閉症還是孤獨症這類心理疾病,越小發現並治療效果就越好。如果有識別情緒的人工智能“夥伴”進入託管所和家庭,那麽這些因為父母工作忙碌而無法得到足夠陪伴的孩子們,就能很大程度預防這些心理疾病;對於接受治療的孩子來說,也能夠以更低的成本得到更優質的個性化治療。

總結

情緒識別的應用太空不可估量,只是如果有一天,人類的情緒能夠完全被人工智能識別,那麽一系列的倫理和道德問題也將伴隨而來:誰有權識別他人的情緒?新一輪的隱私保衛戰該如何打響?情緒識別技術在犯罪領域的應用?屆時,“讓秘密爛在肚子裡”是不是也會成為不安全的選擇?

更多精彩內容,關注鈦媒體微信號(ID:taimeiti),或者下載鈦媒體App